институт европы российской академии наук

Цифровые международные отношения – 2025

- 19 декабря 2025

19 декабря 2025 года ведущий научный сотрудник Отдела исследований европейской интеграции Института Европы РАН Д.Ю. Базаркина приняла участие в IV международной научно-практической конференции «Цифровые международные отношения – 2025. Человек в фокусе цифрового развития», организаторами которой выступили Московский государственный институт международных отношений (МГИМО), Министерство иностранных дел Российской Федерации и Институт системного программирования им. В.П. Иванникова РАН.

Цель конференции – обсудить ключевые тенденции и проблемы цифровой трансформации международных отношений, уделив особое внимание влиянию цифровых технологий на развитие человека. Мероприятие объединило ведущих российских и международных экспертов для определения контуров новой, справедливой и безопасной цифровой архитектуры. Пленарная сессия «Международное развитие цифровых технологий для будущего человечества» задала стратегическую повестку.

Открывая дискуссию, ректор МГИМО МИД России, академик РАН А.В. Торкунов, выступивший ее модератором, обозначил ключевую идею форума – влияние цифровых технологий на развитие человека.

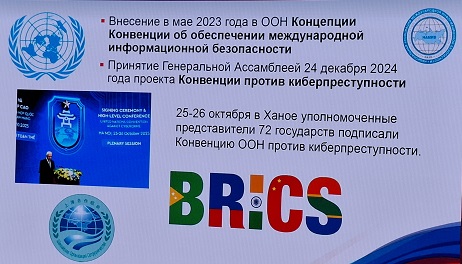

Позицию России по ключевым вопросам цифровой трансформации в своем приветствии к участникам обозначил министр иностранных дел России С.В. Лавров. Его обращение зачитал специальный представитель Президента России по вопросам международного сотрудничества в области информационной безопасности А.Р. Люкманов. С.В. Лавров в своем обращении подчеркнул, что Россия выступает за развитие взаимовыгодного и равноправного международного сотрудничества в цифровой сфере на основе принципов Устава ООН. В качестве конкретного достижения глава МИД РФ привел подписание в октябре в Ханое Конвенции ООН против киберпреступности – первого универсального международного договора в данной области, разработанного при активном участии России.

В рамках конференции прошла мини-конференция «Искусственный интеллект (ИИ) в стратегической коммуникации стран БРИКС: возможности, риски, перспективы», объединившая исследователей и специалистов-практиков из девяти стран (Бразилия, Китай, Колумбия, Малайзия, Намибия, Нигерия, Россия, Румыния, Сербия, Франция) с особенно широким представительством России, Китая и Бразилии. Вступительное слово произнес председатель программного комитета мини-конференции, главный научный сотрудник Центра новых вызовов и угроз Института актуальных международных проблем Дипломатической академии МИД России, главный научный сотрудник факультета международных отношений СПбГУ, доктор исторических наук, профессор Е.Н. Пашенцев.

С приветственным словом к участникам обратился исполняющий обязанности проректора по экспертно-аналитической работе, руководитель Института актуальных международных проблем, заслуженный деятель науки РФ, доктор юридических наук, доктор политических наук, профессор О.Г. Карпович.

На мини-конференции обсуждался широкий круг вопросов, в частности: «умные» города и ИИ в странах БРИКС: новые возможности для стратегической коммуникации; движущие силы, основы и вызовы для сотрудничества стран БРИКС в области ИИ; подходы к пониманию рисков ИИ; злонамеренное использование ИИ и проблемы информационно-психологической безопасности; крупные технологические компании США и риски для стратегической коммуникации ЕС и БРИКС; и многое другое.

Д.Ю. Базаркина представила доклад «Злонамеренное использование искусственного интеллекта (ЗИИИ) в политической борьбе в контексте стратегической коммуникации», в рамках которого рассмотрела кейсы ЕС и БРИКС. По ее наблюдениям, актуальная тенденция проявления ИИ в политической борьбе в Евросоюзе – стремление властей ЕС контролировать крупнейшие технологические компании (Big Tech), которые осуществляют свое политическое влияние, в частности, применяя рекомендательные технологии ИИ или размещая политически острый контент на своих онлайн-платформах. К примеру, в 2024 г. ЕС начал расследование использования технологическими гигантами ИИ, в частности, дипфейков, усилив контроль над технологией, которая, по опасениям чиновников, может помешать выборам в Европейский парламент. Комиссия ЕС просила онлайн-платформы предоставить больше информации о мерах по снижению рисков, связанных с генеративным ИИ, таких, как, к примеру, «галлюцинации», когда ИИ предоставляет ложную информацию, вирусное распространение дипфейков, а также автоматизированное манипулирование сервисами, которое может вводить избирателей в заблуждение.

В то же самое время Big Tech остаются не только монополистами в своей отрасли, но и крупнейшими лоббистами, в том числе в ЕС. Google, Amazon, Meta (признана в России экстремистской и запрещена), Microsoft и Apple (GAMMA) возглавляют список компаний с наибольшими лоббистскими расходами в Европе. Эти пять компаний тратят на лоббирование больше, чем 10 крупнейших компаний финансового сектора или автомобильной промышленности. За последние годы расходы технологической отрасли на лоббирование в ЕС в целом увеличились с 97 до 113 млн евро. Если технологические компании США получат прямой доступ к решениям институтов ЕС, давление на ЕС с целью смягчения его правил цифровизации, таких как Закон о цифровых рынках (DMA), Закон о цифровых услугах (DSA) или Общий регламент по защите данных (GDPR), вероятно, усилится. Подобная информация помогает заключить, что, во-первых, Big Tech продолжает использовать данные граждан для собственного обогащения, и технологии ИИ все более ставятся на службу этому процессу. Во-вторых, крупные технологические компании имеют в ЕС очевидные политические интересы и, вероятно, будут их отстаивать все жестче по мере роста попыток соперничающих политических элит взять Big Tech под контроль. Это может принести ущерб гражданам, интересы которых будут принесены в жертву той или иной стороной конфликта.

В странах БРИКС ЗИИИ в политической борьбе группируется вокруг трёх повторяющихся векторов: синтетическое убеждение (дипфейки, клонированные голосовые звонки, ИИ-аватары/ботнеты, микротаргетинг); информационные операции с использованием ИИ (скрытое производство контента и сети персональных данных, часто трансграничные); а также мониторинг и контроль с использованием ИИ (автоматизированная модерация, распознавание лиц, видеоаналитика). Хотя институциональные контексты различаются, психологические эффекты поразительно схожи: усталость от достоверности и «дивиденд лжеца» (т.е. повышенная вероятность отрицания подлинных доказательств как «поддельных»), вред, наносимый целевым группам, и общая неопределённость относительно происхождения политической коммуникации.

Программа конференции: https://dipacademy.ru/documents/11964/MGIMO_PROGRAMM_CMO_2025.pdf

Программа мини-конференции с биографиями участников: https://www.dipacademy.ru/documents/11953/Subconference_Programme_EN.docx